La IA puede mejorar la eficiencia, ¿pero a qué coste para la experiencia humana?

A medida que nuestras interacciones con los sistemas de IA se vuelven más frecuentes, corremos el riesgo de socavar los fundamentos de lo que nos hace humanos, perdiendo habilidades cognitivas, capacidad de expresión y autonomía personal.

En la segunda parte, exploramos las implicaciones para un diseño de IA centrado en el ser humano.

Las organizaciones no han perdido el tiempo a la hora de adaptar soluciones basadas en IA para ahorrar tiempo y recursos. Por su parte, los consumidores no tienen más opción que exponerse a estos sistemas; sin embargo, también han obtenido beneficios en términos de acceso, comodidad y eficiencia a la hora de conseguir las soluciones que necesitan.

Pero si bien el rendimiento empresarial y la satisfacción general del consumidor pueden verse impulsados, las soluciones de IA presentan importantes limitaciones para los usuarios sobre los que se imponen.

Un equipo de investigadores dirigido por Ana Valenzuela, profesora de los programas Full Time MBA y Executive MBA de Esade, ha examinado cómo la IA restringe la experiencia humana —es decir, la percepción, los sentimientos y los comportamientos de las personas al interactuar con esta tecnología—. Su análisis, publicado en la Journal of the Association of Consumer Research, explora las complejidades que surgen entre las ventajas de la IA y su potencial impacto negativo en los usuarios, y lanza una advertencia urgente para los responsables políticos.

El auge de las máquinas

Los sistemas automatizados mejoran la toma de decisiones empresariales al analizar instantáneamente grandes volúmenes de datos, lo que permite realizar pronósticos más precisos, mejorar los resultados y reducir costes. Para los consumidores, esto significa que la experiencia del consumidor es, cada vez más, una relación con una máquina.

Si bien gran parte del debate sobre la IA se ha centrado en aspectos sociales como la discriminación algorítmica, las preocupaciones sobre la privacidad y los posibles desastres causados por el auge de las máquinas, la investigación en consumo ha comenzado a identificar tensiones psicológicas relacionadas con el modo en que las experiencias personales se ven moldeadas por la interacción con algoritmos.

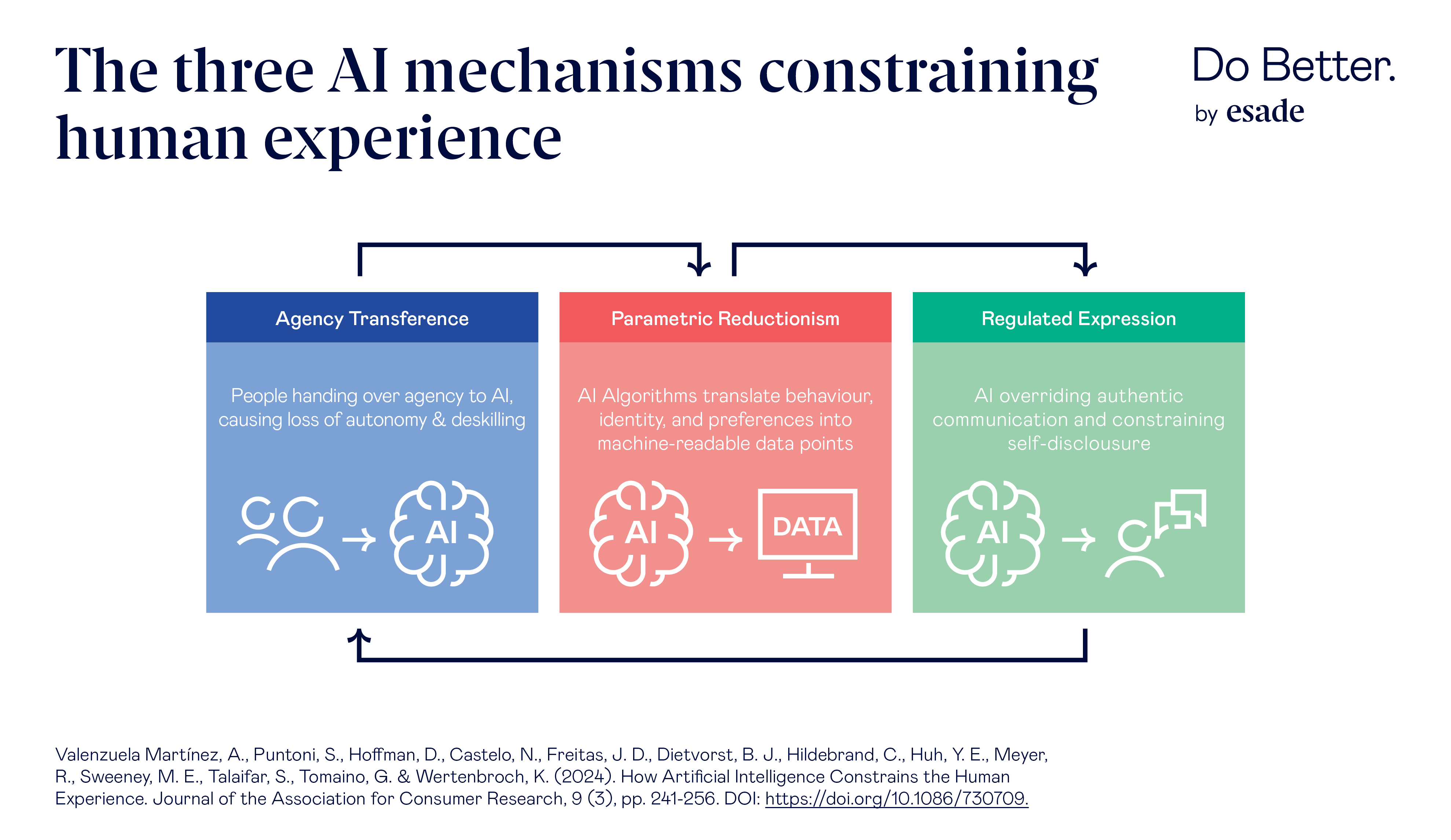

Basándose en estas perspectivas sociales y personales, el equipo de investigación dirigido por Valenzuela identificó tres mecanismos clave a través de los cuales la IA restringe la experiencia humana: la transferencia de agencia, el reduccionismo paramétrico y la expresión regulada.

Decisiones delegadas

A medida que los algoritmos dictan cada vez más nuestras elecciones (qué series de televisión se renuevan en función de las puntuaciones de reacción, qué productos aparecen en los supermercados en línea, etc.), la agencia se transfiere de los humanos a la IA. Los algoritmos manipulan las trayectorias de decisión al ofrecer contenido basado en comportamientos pasados, limitando así el mundo al que estamos expuestos.

Una de las implicaciones más restrictivas de esta transferencia de agencia es la pérdida de la serendipia. Los algoritmos de recomendación reducen significativamente los descubrimientos fortuitos al reforzar comportamientos previos y limitar nuestra capacidad para la exploración y el cambio.

La transferencia de agencia no se limita a la toma de decisiones: también puede llevar a la pérdida de habilidades a manos de la IA. Si la Revolución Industrial marcó un descenso en el número de personas capaces de hilar algodón, la IA tiene el potencial de reemplazar la necesidad para el pensamiento crítico y la generación de ideas creativas.

Las tareas pueden completarse en una fracción del tiempo actual, pero a riesgo de acabar menoscabando valiosas habilidades cognitivas y prácticas, especialmente entre los trabajadores del conocimiento que dependen de la IA para mejorar la ejecución de sus tareas. Y las repercusiones potenciales van más allá de la pérdida de habilidades laborales, pues pueden afectar también a los patrones del habla y a las habilidades sociales.

Por ejemplo, estudios sobre el uso del smartphone y las habilidades sociales han encontrado que los jóvenes presentan niveles mucho más bajos de inteligencia emocional, atención plena y competencia social que las personas de mediana edad y mayores. Otras investigaciones han señalado el impacto negativo de internet en la memoria: la información no necesita retenerse si está al alcance de un clic.

El reduccionismo de la humanidad

El segundo mecanismo identificado es el reduccionismo paramétrico. Los algoritmos reducen el comportamiento humano a un conjunto de variables, parámetros y fórmulas, categorizando y puntuando la complejidad del pensamiento humano para predecir el comportamiento. Cuando los humanos son objetivados a través de la lente de la IA, inevitablemente surgen sesgos y discriminaciones (como en el notable caso de las prácticas de contratación discriminatorias de Amazon, donde sus algoritmos daban más peso a características tradicionalmente asociadas a los hombres).

La codificación del comportamiento pasado genera una desconexión entre lo que el algoritmo predice y ofrece, y los factores que realmente influyen en las elecciones individuales. Además, ignora el hecho de que los deseos de las personas a menudo entran en conflicto con sus propios objetivos: personas que quieren dejar el alcohol pueden verse tentadas por ofertas basadas en sus anteriores hábitos de compra.

Asimismo, los usuarios pueden sentirse desconectados de los sistemas de IA que no reflejan sus verdaderas preferencias o individualidad, especialmente en áreas sensibles.

La paradoja de la privacidad

Finalmente, los autores identifican un tercer mecanismo. La expresión regulada se refiere a la forma en que los sistemas de IA influyen, alteran o restringen la comunicación y la autoexpresión de los individuos, tanto con la tecnología como con otras personas.

Este fenómeno proviene de distintas fuentes, siendo una de ellas la autoexposición voluntaria. La IA se basa en grandes volúmenes de datos y los consumidores deben proporcionar cada vez más información personal para realizar tareas básicas, como descargar una aplicación para pedir una bebida en un bar. Muchos consumidores suelen expresar preocupación por la cantidad de información que se espera que compartan en línea y en aplicaciones, pero luego no tienen reparo en utilizar las redes sociales para divulgar los detalles más íntimos de su vida privada. Esta paradoja de la privacidad influye en cómo las personas interactúan entre sí y con la IA, y anula los instintos naturales de comunicación.

Otra fuente de expresión regulada es la interacción y autoexpresión restringidas. Si un consumidor sabe que está comunicándose con un chatbot, limitará la información que proporciona y modificará su lenguaje. En cambio, si cree que su interlocutor es un ser humano, estará más abierto a compartir detalles personales. Las empresas están explotando este conocimiento para hacer que la interacción con los sistemas automatizados sea más humana: cuanto más natural parezca la conversación, más información estará dispuesto a compartir el consumidor.

Un problema urgente para la sociedad

A medida que estas prácticas de recopilación y procesamiento de datos se extienden, las personas son cada vez más desconfiadas y reservadas. Su expresión y comunicación se vuelven menos naturales y su comportamiento más controlado.

Esto tiene un impacto mucho mayor que la simple protección de datos: la falta de autenticidad en el comportamiento en línea es un predictor de menor bienestar, una mayor propensión a problemas de salud mental y una percepción distorsionada de la realidad en sociedad.

Dado que el uso de la IA avanza sin restricciones claras ni estándares definidos, las relaciones entre consumidores y empresas se automatizan cada vez más. Más allá de la experiencia del cliente, la omnipresencia de la IA en sectores como la sanidad, la justicia penal o el empleo puede estar restringiendo la autonomía, las habilidades, la equidad, la dignidad y la diversidad.

Los responsables políticos deben priorizar un escrutinio urgente para garantizar que la IA empodera y enriquece la experiencia humana, en lugar de controlarla. En la segunda parte de este artículo, profundizamos en la propuesta de los autores para un diseño de IA centrado en el ser humano.

- Compartir en Twitter

- Compartir en Linked in

- Compartir en Facebook

- Compartir en Whatsapp Compartir en Whatsapp

- Compartir en e-Mail

Programas relacionados

¿Quieres recibir la newsletter de Do Better?

Suscríbite para recibir nuestro contenido destacado en tu bandeja de entrada..