Por qué los algoritmos pueden estar agravando la polarización política más de lo que creemos

Los sistemas de recomendación no solo organizan contenidos; ayudan a organizar la percepción. Marc Torrens y Carlos Carrasco-Farré analizan cómo los algoritmos influyen en las opiniones y aumentan nuestras respuestas emocionales.

Imagina abrir tu plataforma online preferida para ver noticias políticas. No estás buscando extremismo. No quieres profundizar en ningún conflicto. Haces clic en un vídeo, luego en otro, después en otro más. Y, poco a poco, el mundo político que se te presenta empieza a cambiar. Tu propio lado político parece más nítido, más seguro, más cargado emocionalmente. El otro lado parece más extremo, más provocador, más amenazante. La plataforma no te ha dicho qué pensar. Pero puede haber cambiado silenciosamente el mapa emocional de la política a tu alrededor.

En otras palabras, los sistemas de recomendación no solo organizan contenidos. Ayudan a organizar la percepción. Además, cada vez es más difícil consumir contenido online que no esté mediado por sistemas de recomendación o algoritmos de personalización. Consumimos lo que los algoritmos filtran y priorizan para nosotros.

Los algoritmos de recomendación influyen en qué voces se perciben como representativas, qué posiciones parecen normales y qué oponentes resultan más visibles. En el ámbito político, esto puede tener consecuencias que van mucho más allá del tiempo de pantalla. Puede moldear cómo los ciudadanos entienden el desacuerdo, cómo escala el conflicto y cómo se vive la democracia en la práctica. En ese sentido, el algoritmo no solo estrecha lo que vemos. También puede estar elevando su intensidad emocional.

Lo que aparece en nuestras pantallas no es una muestra neutral de la vida pública. Es el resultado de decisiones técnicas, comerciales y organizativas sobre qué merece ser amplificado. Y esas decisiones pueden influir en cómo los ciudadanos imaginan a sus oponentes, cómo se percibe el conflicto y cómo se desarrolla el debate democrático. Esto importa porque millones de personas aprenden y se informan sobre política a través de sistemas diseñados principalmente para atraer la atención. Estos algoritmos no están diseñados para maximizar la frecuencia y la duración de la interacción del usuario. Son sistemas impulsados por incentivos económicos.

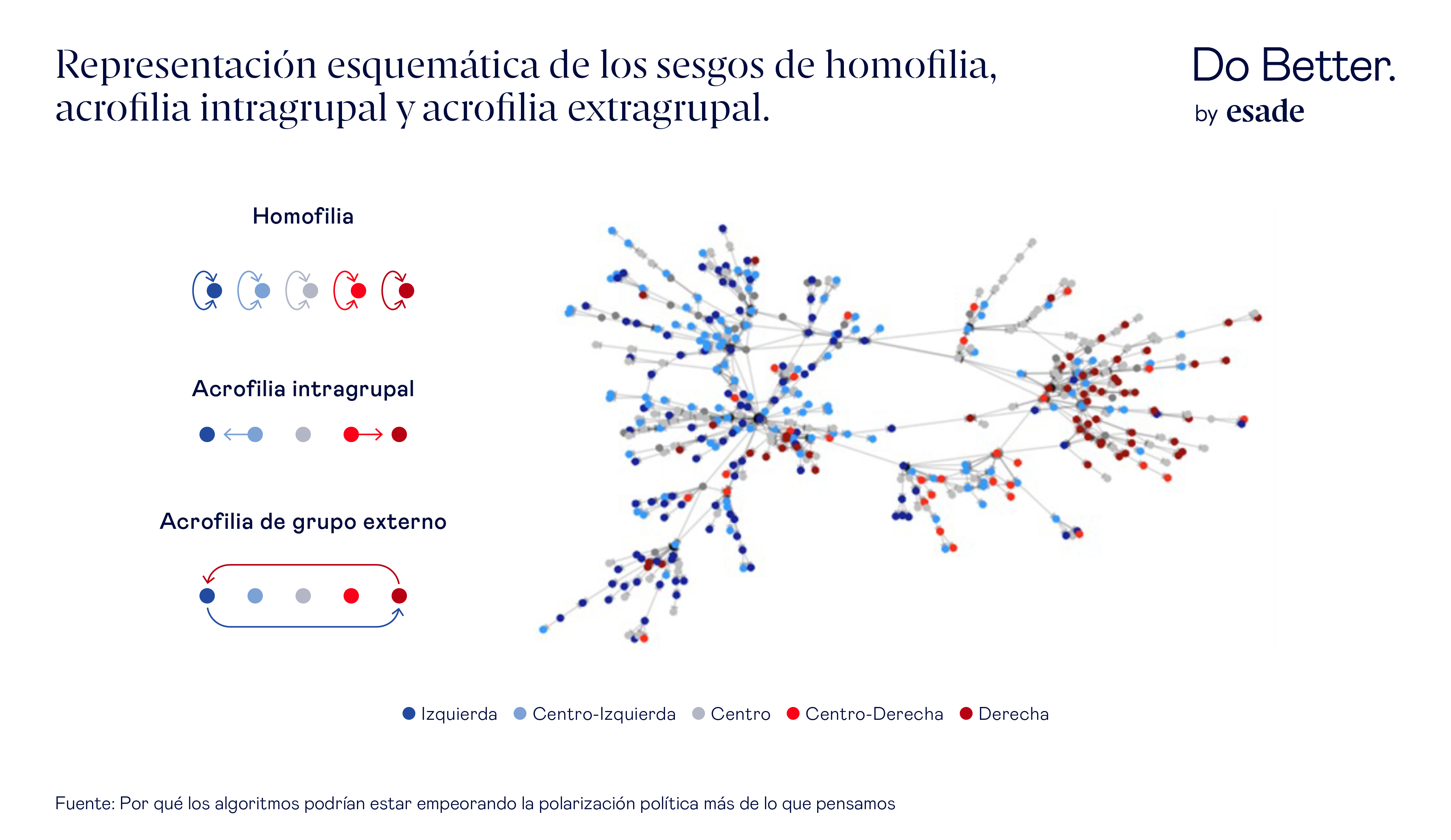

El profesor asociado del Departamento de Operaciones, Innovación y Data Science de Esade, Marc Torrens, y el profesor de Ciencia de Datos en TBS Education, Carlos Carrasco-Farré, realizaron un estudio en el que analizaron la red de recomendaciones políticas de YouTube utilizando más de 300.000 vídeos y aproximadamente 1,7 millones de enlaces de recomendación. Su pregunta era sencilla: cuando alguien ve contenido político, ¿qué tipo de contenido le sugiere después la plataforma? La respuesta fue preocupante: los patrones de recomendación pueden favorecer la extremidad ideológica de dos maneras diferentes. Primero, dirigiendo a los usuarios hacia contenido más extremo dentro de su propio espectro político. Segundo, exponiéndolos de forma desproporcionada a contenido extremo del espectro político opuesto.

Los resultados de esta investigación han sido publicados en el Journal of Management Information Systems.

El algoritmo no solo nos refleja; estructura cómo se ve el conflicto

La defensa habitual de los sistemas de recomendación es que simplemente reflejan las preferencias de los usuarios. Las personas hacen clic, las plataformas aprenden y el sistema ofrece más de lo que parece interesarles. Pero los hallazgos de Torrens y Carrasco-Farré sugieren que está ocurriendo algo diferente.

La acrofilia comienza como una tendencia social: las personas suelen orientarse hacia expresiones más intensas y emocionalmente resonantes de la identidad de su grupo. Sin embargo, en las plataformas digitales, esa tendencia deja de ser puramente humana. Se organiza, se repite y se amplifica mediante algoritmos. En ese sentido, los sistemas de recomendación no solo reflejan la polarización. Pueden darle forma. Pueden convertir una tendencia psicológica humana en una característica recurrente del entorno informativo.

Esto es especialmente relevante porque un entorno democrático saludable no requiere que todos estén de acuerdo. Pero sí exige que el desacuerdo sea inteligible. Cuando las plataformas muestran repetidamente la versión más emocionalmente explosiva de los oponentes políticos, no están ampliando la comprensión. Están entrenando la atención hacia la confrontación y la polarización.

Dos caminos hacia la polarización, no uno

El primer camino es bastante conocido. Un usuario consume contenido cercano a su visión del mundo y el sistema lo empuja hacia una versión más extrema de esa misma visión. En el estudio, esto se observó claramente en la transición de contenidos de centro-derecha hacia contenidos de derecha más radical. Esto es acrofilia intragrupal: no se trata solo de permanecer entre afines, sino de ser arrastrado hacia los más intensos.

El segundo camino es menos evidente y, posiblemente, más peligroso. El usuario no solo recibe contenido de su propio lado, sino también contenido extremo del lado contrario. No se trata de un desacuerdo moderado ni de una oposición constructiva, sino de la versión más emocional y distante ideológicamente del otro grupo. Ambos investigadores encontraron este patrón tanto en recomendaciones de izquierda a derecha como de derecha a izquierda. Esto es acrofilia extragrupal.

Puede parecer abstracto, pero su implicación cotidiana es clara. Alguien que comienza con contenido moderado puede acabar siendo dirigido hacia las voces más intensas de su propio lado y hacia las más incendiarias del lado opuesto. El resultado es un campo político distorsionado: tus aliados parecen más radicalizados, tus oponentes más exagerados y el centro resulta más difícil de ver. No es solo más información. Es una realidad social distinta.

Pero ¿por qué importa esto? Porque la exposición a la diferencia no es lo mismo que la exposición a la comprensión. Un entorno informativo saludable podría introducir alternativas moderadas, puntos de encuentro inesperados o desacuerdos que inviten a la reflexión. Pero cuando una plataforma muestra sistemáticamente la caricatura más extrema del adversario, puede profundizar la hostilidad en lugar de ampliar la perspectiva. El resultado no es deliberación. Es confrontación optimizada para captar atención.

La emoción como parte del mecanismo

Uno de los hallazgos más llamativos del estudio es que estos patrones de recomendación están estrechamente vinculados a la emoción. El contenido asociado a estos sesgos no era solo ideológico, sino también emocionalmente cargado.

En la acrofilia intragrupal, emociones como la ira y la incertidumbre aparecían con especial relevancia, a menudo relacionadas con instituciones y cuestiones morales. En la acrofilia extragrupal, la combinación emocional se desplazaba hacia el asco y la tristeza, especialmente en temas de cultura, valores e identidad. En la práctica, esto significa que el algoritmo no solo clasifica contenido por tema o ideología, sino también por intensidad emocional.

Esto ayuda a explicar por qué estos patrones resultan tan potentes. El contenido político de alta activación emocional es memorable, genera reacción y refuerza la frontera entre “nosotros” y “ellos”. En una economía de la atención, esto lo hace valioso, no necesariamente porque informe mejor, sino porque mantiene al usuario implicado.

La emoción no es un efecto secundario de la política digital; es uno de sus motores. El contenido negativo de alta intensidad emocional atrae atención, genera interacción y sostiene la actividad de las plataformas. Pero lo que es bueno para la interacción no siempre es bueno para la vida pública. Un sistema optimizado para maximizar reacciones puede terminar priorizando la indignación frente al matiz y la hostilidad frente a la comprensión.

Por qué debería importarle a cualquier usuario

Es tentador pensar que esto es un problema técnico que deben resolver las plataformas o los reguladores. No lo es. Afecta a cualquiera que obtenga información política a través de plataformas digitales, es decir, a la mayoría de nosotros.

Cuando los sistemas de recomendación amplifican sistemáticamente narrativas extremas, no solo moldean el consumo de contenido. Moldean señales de identidad social. Influyen en cómo las personas perciben lo que representa “su lado”, cómo es “el otro lado” y qué comportamientos políticos parecen normales. Con el tiempo, esto puede endurecer fronteras grupales, aumentar la hostilidad y hacer que el consenso o los puntos en común parezcan ingenuos o incluso peligrosos.

Por eso, el problema va más allá de YouTube. Los sistemas de recomendación son ya infraestructuras centrales de la atención pública. Median noticias, cultura y el sentido cotidiano de la política. Si su lógica interna recompensa el contenido más polarizador, la polarización no solo surge de la sociedad: también está siendo estructurada por la arquitectura de la exposición.

Esto tiene consecuencias para la desinformación, la confianza, el debate público y la cohesión social. Si el entorno digital recompensa sistemáticamente lo más ruidoso y antagonista, el discurso democrático se vuelve más difícil de sostener. No solo consumimos política a través de estos sistemas. Cada vez más, aprendemos qué es la política a través de ellos.

Qué debería cambiar

Si las plataformas ayudan a estructurar el conflicto ideológico, también tienen responsabilidad en reducir sus formas más dañinas. Esto no significa eliminar el desacuerdo ni imponer equilibrios artificiales, sino reconocer que la interacción no puede ser el único objetivo.

El primer paso es dejar de considerar estos sistemas como neutrales. No son espejos pasivos de las preferencias, sino actores sociotécnicos que determinan qué se vuelve visible, relevante y emocionalmente significativo.

El estudio apunta a varias posibles soluciones: modelos de recomendación que incorporen diversidad, mayor transparencia sobre por qué se recomienda cierto contenido, herramientas para que los usuarios entiendan la composición de su entorno informativo y auditorías independientes que evalúen si los sistemas amplifican contenido extremo o engañoso.

Nada de esto eliminará el desacuerdo. Ni debería hacerlo. Pero hay una diferencia entre desacuerdo y distorsión. Entre exposición a diferencias y exposición constante a su versión más extrema.

Un entorno digital más saludable no nos aislaría del conflicto. Evitaría que el conflicto sea el modo por defecto de nuestra atención.

La lección de fondo

El peligro no es solo que los algoritmos nos den más de lo que ya creemos.

Es que pueden enseñarnos a ver la política como una escalada constante: una versión más extrema de nuestro propio lado y una versión más caricaturizada del contrario. Cuando eso ocurre, la polarización deja de ser solo un problema de diseño. Se convierte también en un problema social.

Profesor titular, Departamento de Operaciones, Innovación y Data Sciences en Esade

Ver perfil- Compartir en Twitter

- Compartir en Linked in

- Compartir en Facebook

- Compartir en Whatsapp Compartir en Whatsapp

- Compartir en e-Mail

¿Quieres recibir la newsletter de Do Better?

Suscríbite para recibir nuestro contenido destacado en tu bandeja de entrada..